人類很自然地就學會如何將他們在世界上的位置與他們從世界上收集到的信息聯系起來,并學習如何根據此類信息采取行動。例如,如果有人向另一個人扔球,而時間足夠的話,人類可以學會衡量他們與球的關系,并舉起手來接住球,該過程稱為“主動感知”(active perception),可讓人類根據感覺預測未來的動作。

人類的感覺系統和運動系統是統一的,意味著一個事件的記憶包含了此類信息的組合。另一方面,機器人和無人機等系統的攝像頭和運動是獨立的系統,有獨立的數據流。如果能夠將此類數據結合,機器人和無人機就能夠創造自己的“記憶”,并能更有效地學習以模仿主動感知。

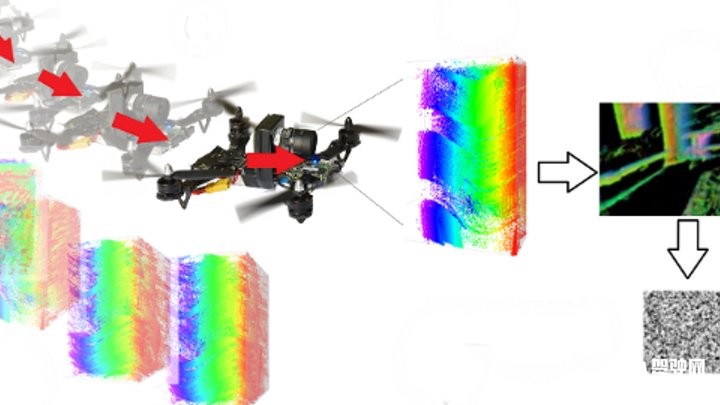

研究人員使用了iniLabs的DAVIS 240b DVS(動態視覺傳感器)和高通公司的 Flight Proboard。DAVIS 240b DVS只會對場景中的變化做出反應,類似于人類眼睛中的神經元只在感受到光線變化時才會發出信號,而高通的 Flight Proboard安裝在一個四軸無人機上。

使用一種稱為多維二進制向量(HBV)的數據表現形式,無人機攝像頭的信息和無人機速度信息被存儲在相同的數據記錄中。然后,卷積神經網絡(CNN)只有DVS的視覺記錄可作為參考,需要記住無人機采取的動作。卷積神經網絡能夠通過參考攝像頭和速度數據結合產生的“記憶”,在所有的實驗中,都能100%地準確完成任務。

相比于兩個分開的數據流,該實驗的原理是可以讓機器視覺系統更快地參考事件和反應數據,在捕捉到特定的視覺數據時,可讓機器人或自動駕駛汽車預測未來采取的動作,即基于輸入的感知數據預測動作。或者,更簡單地說,想象未來發生的事件,并提前思考好下一步動作。